Als der KI-Bildgenerierungsprozess in die „Professionelle Ebene“ eintritt, definiert Adobe mit einer umfassenden Aktualisierung erneut den kreativen Workflow. Am 29. Oktober gab Adobe seine neueste Bildgenerationsmodelle – Firefly Image5 – offiziell bekannt und stellte gleichzeitig mehrere bahnbrechende Funktionen vor: native Ausgabe von 4 Millionen Pixeln, schichtbasierte Textbearbeitung, benutzerdefinierte Kunststil-Modelle, KI-Sprache und Musikgenerierung. So wird der gesamte KI-Kreativzyklus für Bilder, Videos und Audio vollständig abgeschlossen.

Image5: Der Sprung von „ausreichend“ zu „professionell“

Im Vergleich zur Vorgänger-Version, die nur 1 Million Pixel native Generierung unterstützte (die später auf 4 Millionen Pixel vergrößert werden musste), kann Firefly Image5 direkt hochwertige Bilder mit bis zu 4 Millionen Pixeln (ca. 2240 × 1792) generieren. Die Schärfe und Farbdarstellung sind deutlich verbessert. Besonders bei der Darstellung von Personen hat Adobe die Gesichtsstruktur, das Verhältnis der Gliedmaßen und die Lichtlogik optimiert und so Probleme wie „Künstliche Intelligenz-Fehlerhände“ reduziert, wodurch das Ergebnis dem Standard professioneller Illustrationen und kommerzieller Fotografie näher kommt.

Revolutionär ist auch ihre schichtbasierte Bearbeitungsfähigkeit: Das Modell identifiziert verschiedene Objekte im Bild automatisch als unabhängige Ebenen. Benutzer können durch natürliche Sprachanweisungen (wie „Den Hut rot machen“ oder „Das Hintergrundgebäude vergrößern“) oder traditionelle Werkzeuge (Drehen, Vergrößern) präzise Anpassungen an einzelnen Elementen vornehmen, während das System die Lichtkonsistenz und Detailintegrität des gesamten Bildes intelligent beibehält. So wird die „was man sich vorstellt, ist was man bekommt“-Nicht-destruktive Bearbeitung erreicht.

Kreatoren-spezifische KI: Ein Klick zum Training eines individuellen Stilmodells

Um den hohen Ansprüchen professioneller Künstler an die Stilkonstanz gerecht zu werden, hat Adobe eine Funktion zur Erstellung benutzerdefinierter Modelle (Closed Beta) eingeführt. Benutzer müssen nur ihre Illustrationen, Fotos oder Skizzen ziehen und loslassen, und das System trainiert dann ein eigenes Bildgenerationsmodell basierend auf diesen Assets, um sicherzustellen, dass die generierten Inhalte vollständig mit ihrer persönlichen künstlerischen Sprache übereinstimmen. Diese Fähigkeit wird die Arbeitseffizienz in Szenarien wie Markenvisualisierung, Charaktergestaltung und IP-Entwicklung stark steigern und KI damit zum „digitalen Lehrling“ machen.

Multi-modale Kreationsplattform: Bild + Video + Audio integriert

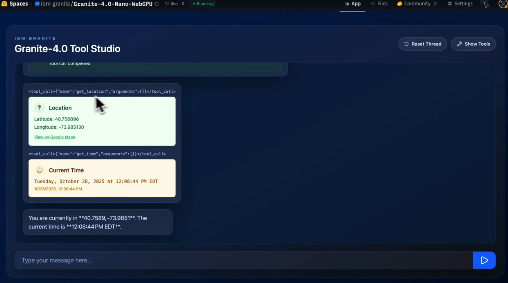

Die neue Version von Firefly ist nun zu einem zentralen multi-modalen Kreativitätszentrum umgestaltet:

Eine einheitliche Eingabemaske ermöglicht den nahtlosen Wechsel zwischen Bild- und Videogenerierung;

Der Modellauswahlschalter integriert Adobe-eigene Modelle sowie Drittanbieter-Engines wie OpenAI, Google, Runway, Topaz und Flux;

Die Startseite vereint persönliche Dateien, historische Generierungsprotokolle und schnelle Zugangsschaltflächen zu Creative Cloud-Anwendungen;

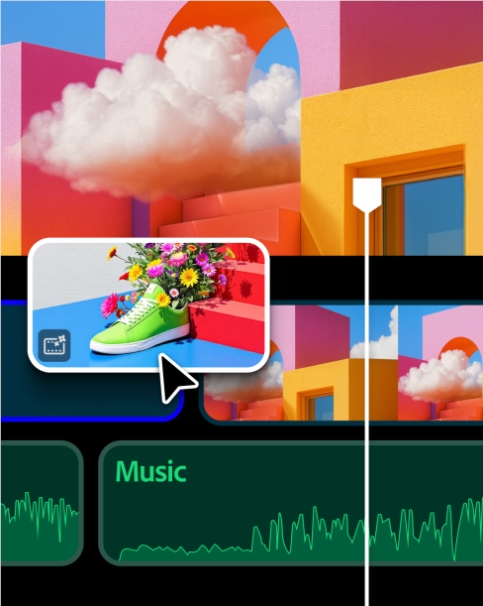

Video-Tools bieten nun Zeitleisten und schichtbasierte Bearbeitung (Private Beta) und bewegen sich somit Richtung professionellem AI-Videoworkflow.

Auch im Audio-Bereich unterstützt Firefly nun die Generierung vollständiger Soundtracks und Sprachbegleitungen durch KI-Hinweise. Unter der Haube wird das Voice-Modell von ElevenLabs verwendet, und es wurde auch eine „Wortwolken-Hinweis“-Funktion eingeführt – Benutzer können Schlüsselwörter anklicken, um komplexe Anweisungen schnell zu erstellen und damit den Kreativitätsbarrieren zu entgegenwirken.

Zielgruppe „nächste Generation der Kreatoren“: Grenzen traditioneller Workflows überwinden

Adobe's Generative AI Vice President Alexandru Costin sagte, dass die Zielgruppe von Firefly „GenAI-native Kreatoren“ sei – sie halten sich nicht an die logischen Strukturen traditioneller Software, sondern bevorzugen es, KI tief in den gesamten Prozess zu integrieren. Aus diesem Grund konnte Firefly die Interaktionsgewohnheiten klassischer Tools wie Photoshop verlassen und mutig die Oberfläche und Funktionen neu gestalten, um eine kreative Erfahrung zu schaffen, die intuitiver für die KI-Ära ist.