Según un estudio de la Universidad Aalto, el uso de herramientas de inteligencia artificial (IA) podría hacernos tener una mala percepción de nuestras capacidades cognitivas. En general, las personas tienden a autoevaluarse como "ligeramente mejores que el promedio", fenómeno más evidente en personas con peores resultados en pruebas cognitivas, conocido como "Efecto Dunning-Kruger". Esto significa que las personas con menor capacidad suelen sobreestimar su habilidad, mientras que las personas con mayor capacidad tienden a subestimarla.

Nota de la fuente de la imagen: La imagen fue generada por IA, el proveedor de licencias es Midjourney

No obstante, este nuevo estudio de la Universidad Aalto revela que esta tendencia no se aplica cuando se trata de modelos de lenguaje grandes (como ChatGPT). El estudio encontró que, independientemente del nivel de competencia en IA de los usuarios, todos tienden a sobreestimar su desempeño al usar IA. Especialmente aquellos usuarios que consideran que tienen mayor competencia en IA, tienden a ser aún más confiados de manera excesiva.

Los investigadores indicaron que este hallazgo fue inesperado, ya que normalmente se espera que las personas con mayor competencia en IA no solo tengan un mejor desempeño al interactuar con la IA, sino también una evaluación más precisa de su propio desempeño. Sin embargo, lo opuesto resultó ser cierto. El estudio señaló que aunque los usuarios de ChatGPT tuvieron un mejor desempeño en las tareas, todos se sintieron excesivamente seguros de su desempeño.

Además, el estudio destacó la importancia de la competencia en IA, señalando que las herramientas actuales de IA no fomentan eficazmente la metacognición de los usuarios (es decir, la conciencia de su propio proceso de pensamiento), lo que podría provocar una "caída intelectual" al obtener información. Por lo tanto, los investigadores instaron al desarrollo de nuevas plataformas que animen a los usuarios a reflexionar sobre su proceso de pensamiento.

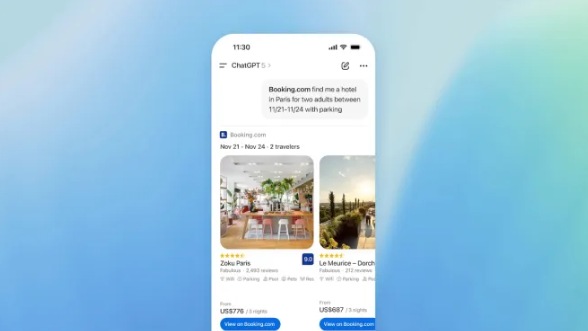

En el experimento, el equipo de investigación pidió a aproximadamente 500 participantes que usaran la IA para completar tareas de razonamiento lógico del examen de admisión a la escuela de derecho (LSAT). Los resultados del experimento mostraron que la mayoría de los usuarios hicieron solo una pregunta a ChatGPT y no realizaron una reflexión o verificación profunda de las respuestas de la IA. Los investigadores llamaron a este fenómeno "descarga cognitiva", que podría limitar la capacidad de los usuarios para juzgar con precisión sus propias habilidades.

Para resolver este problema, los investigadores sugieren que la IA puede preguntar activamente a los usuarios si pueden explicar adicionalmente su proceso de razonamiento, lo que impulsaría a los usuarios a participar de manera más profunda en la interacción con la IA y mejorar así su capacidad de pensamiento crítico.

Puntos clave:

🔍 La mayoría de las personas sobreestiman su desempeño cognitivo al usar IA, especialmente los usuarios con mayor competencia en IA.

🤖 Las personas tienden a no tener una buena evaluación de su propia habilidad al usar herramientas de IA como ChatGPT.

📈 El estudio sugiere que la IA debe fomentar la metacognición de los usuarios, animándolos a pensar y reflexionar más profundamente.