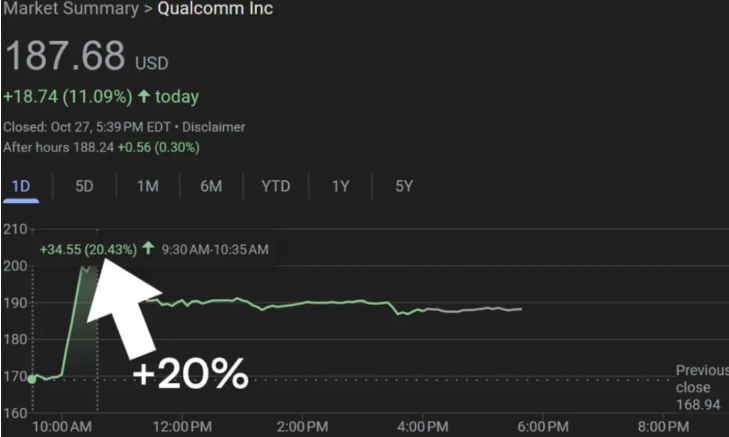

Hace poco, este gigante conocido por sus chips para teléfonos móviles anunció el lanzamiento de dos nuevos chips diseñados específicamente para la inferencia de inteligencia artificial en la nube: AI200 (comercializado en 2026) y AI250 (lanzado en 2027), lo que marca un salto clave hacia ser un jugador integral en infraestructura de inteligencia artificial. Al salir la noticia, las acciones de Qualcomm subieron más del 20% en un solo día, alcanzando su mayor aumento desde 2019, demostrando que los mercados financieros confían con dinero real.

Enfocarse en escenarios de inferencia, romper el mercado con eficiencia y costo

A diferencia de NVIDIA, que se enfoca en una solución integral de entrenamiento e inferencia, Qualcomm elige enfocarse en el mercado de inferencia de grandes modelos, destacando tres ventajas principales: "bajo costo total de propiedad (TCO) + alta eficiencia energética + gran memoria".

- El AI200 admite hasta 768 GB de memoria LPDDR, puede funcionar como tarjeta aceleradora independiente o como sistema completo, optimizado especialmente para modelos de lenguaje grande y la inferencia multimodal, satisfaciendo las necesidades de empresas con alto volumen de tráfico y baja latencia;

- El AI250 va aún más lejos, introduciendo una arquitectura de cálculo cercano a la memoria (near-memory computing), afirmando que aumenta diez veces el ancho de banda de la memoria, al mismo tiempo que reduce significativamente el consumo de energía, estableciendo así un nuevo estándar de eficiencia energética para la implementación a gran escala.

Esta estrategia aborda directamente las dolencias actuales en los centros de datos: a medida que los costos de la inferencia de modelos aumentan drásticamente, las empresas buscan soluciones económicas y de bajo consumo energético, no solo un rendimiento máximo.

Diez años de preparación, el Hexagon NPU es el motor clave

Qualcomm no actuó de forma improvisada. Desde 2019, ha estado acumulando experiencia en chips para la nube en los campos de Internet de las cosas y computación en el borde de 5G, y su arma principal es su propio procesador neuronal Hexagon (NPU). Después de varios años de iteración, Hexagon se ha transformado de un acelerador de inteligencia artificial para teléfonos móviles en un motor de inferencia de alto rendimiento escalable a los centros de datos, convirtiéndose en el punto de apoyo tecnológico de Qualcomm para competir en el mercado de la nube.

Grandes jugadores persiguen a NVIDIA, el mercado llega a un punto de "descentralización"

Aunque NVIDIA actualmente tiene aproximadamente el 90% de la cuota de mercado en chips de inteligencia artificial, la demanda de diversificación en la cadena de suministro está creciendo cada vez más. Empresas como Google (TPU), Amazon (Trainium/Inferentia), Microsoft (Maia) ya han desarrollado sus propios chips, y la entrada de Qualcomm ofrece una nueva opción para proveedores independientes. McKinsey predice que la inversión global en centros de datos alcanzará 6,7 billones de dólares para 2030, un mercado azul suficiente para albergar a múltiples jugadores.

Qualcomm ya ha conseguido su primer cliente importante: la empresa emergente de inteligencia artificial saudita Humain planea implementar sistemas de estantería basados en AI200/AI250 en 2026, con una potencia total de 200 megavatios, equivalente al consumo eléctrico de una pequeña ciudad.

¿Puede desafiar al líder? La clave está en la ecosfera y la implementación

Desafiar a NVIDIA, el rendimiento del chip es solo el ticket de entrada, pero la ecosfera de software, el apoyo a desarrolladores y los resultados de la implementación real son decisivos. ¿Podrá Qualcomm replicar su capacidad de integración ecosférica en el sector móvil, construyendo una pila completa de inferencia desde herramientas hasta marcos, determinará si puede realmente capturar el mercado de gama alta.