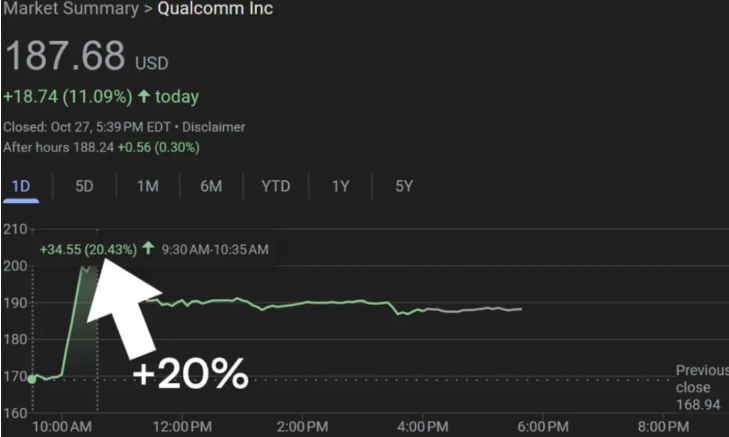

Kürzlich kündigte dieser weltweit bekannte Hersteller von Mobilfunk-Chips zwei neue Chips an, die speziell für Cloud-Intelligenzverarbeitung (AI-Inference) entwickelt wurden: AI200 (ab 2026 kommerziell erhältlich) und AI250 (2027 verfügbar), was eine entscheidende Verlagerung seiner Rolle als Endgeräte-Chip-Hersteller hin zu einem vollständigen Spieler im AI-Infrastruktur-Sektor markiert. Als die Nachricht bekannt wurde, stieg der Aktienkurs von Qualcomm um mehr als 20 % an einem Tag und erreichte den größten Anstieg seit 2019. Der Kapitalmarkt hat mit echtem Geld sein Vertrauen gezeigt.

Verfolgung des Inferenz-Szenarios, Lösung durch Energieeffizienz und Kosten

Im Gegensatz zur allumfassenden Strategie von NVIDIA, die sowohl Training als auch Inferenz abdeckt, konzentriert sich Qualcomm auf den Markt für große Modell-Inferenz und betont drei Vorteile: „niedrige Gesamtbetriebskosten (TCO) + hohe Energieeffizienz + großes Speicher容量“.

- Der AI200 unterstützt bis zu 768 GB LPDDR-Speicher und kann als eigenständiges Beschleunigungskarten-System oder als gesamtes Rack-System geliefert werden. Er ist speziell für große Sprachmodelle und Multimodal-Inferenz optimiert und erfüllt die Anforderungen von Unternehmen an hohe Konkurrenzfähigkeit und niedrige Latenz bei der Inferenz;

- Der AI250 geht einen Schritt weiter und integriert ein „Near-Memory Computing“-Architektur, wodurch die Speicherbandbreite um das Zehnfache gesteigert wird und gleichzeitig der Stromverbrauch stark reduziert wird. Dies bietet einen neuen Standard für Energieeffizienz bei der Übergrößen-Deployment.

Diese Strategie trifft direkt auf die aktuellen Probleme in Rechenzentren: Mit steigenden Kosten für Modell-Inferenz benötigen Unternehmen dringend kosteneffiziente, energiesparende Lösungen, nicht einfach nur maximale Rechenleistung.

Zehn Jahre Arbeit, Hexagon NPU als Schlüsseltrieb

Qualcomm handelte nicht aus dem Impuls heraus. Seit 2019 hat der Hersteller Erfahrungen im Bereich Cloud-Chips in IoT und 5G-Edge-Computing gesammelt, wobei der zentrale Waffe seine selbstentwickelte Hexagon Neural Processing Unit (NPU) ist. Nach jahrelanger Weiterentwicklung ist die Hexagon von einem Mobilfunk-AI-Beschleuniger zu einem leistungsstarken Inferenz-Engine geworden, die sich auf Datenzentren erstreckt und somit zum technischen Stützpfeiler für Qualcomms Eintritt in den Cloud-Markt wird.

Größere Akteure jagen NVIDIA, Marktwandel zu „Diversifizierung“

Obwohl NVIDIA aktuell etwa 90 % des AI-Chip-Marktes kontrolliert, wächst die Sehnsucht nach einer diversifizierten Lieferkette immer stärker. Google (TPU), Amazon (Trainium/Inferentia), Microsoft (Maia) usw. haben bereits eigene Chips entwickelt, und Qualcomms Eintritt bietet einen neuen Auswahlmöglichkeiten für unabhängige Drittanbieter. McKinsey prognostiziert, dass die globale Investition in Rechenzentren bis 2030 6,7 Billionen Dollar erreichen wird. Dieser blau strahlende Markt kann zahlreiche Akteure beherbergen.

Qualcomm hat bereits seinen ersten schweren Kunden gewonnen: Die saudische AI-Start-up-Firma Humain plant, ab 2026 Rechenrack-Systeme basierend auf AI200/AI250 einzusetzen, mit einer Gesamtleistung von 200 Megawatt, was der elektrischen Last einer kleinen Stadt entspricht.

Kann es den Herrscher erschüttern? Schlüssel liegt in Ökosystem und Umsetzung

Die Herausforderung von NVIDIA ist nur ein Eintrittstitel. Software-Ökosystem, Entwicklerunterstützung und praktische Implementierungseffekte sind entscheidend für den Sieg. Kann Qualcomm seine Fähigkeit zur ökonomischen Integration, die er in der mobilen Welt bewiesen hat, replizieren und eine vollständige Inferenz-Stack-Struktur von Tools bis Frameworks aufbauen, wird dies entscheiden, ob es tatsächlich einen Teil des Hochleistungssegments ergreifen kann.

Aber egal wie, Qualcomms starke Eintrittsaktion hat bereits einen wichtigen Wechsel in den AI-Chip-Kämpfen eingebracht. Wenn der „König der Mobilfunk-Chips“ entschlossen ist, einen Sturm im Cloud-Bereich auszulösen, könnte der Fluss, der NVIDIA schützt, vielleicht nicht mehr so stabil sein wie vorher.