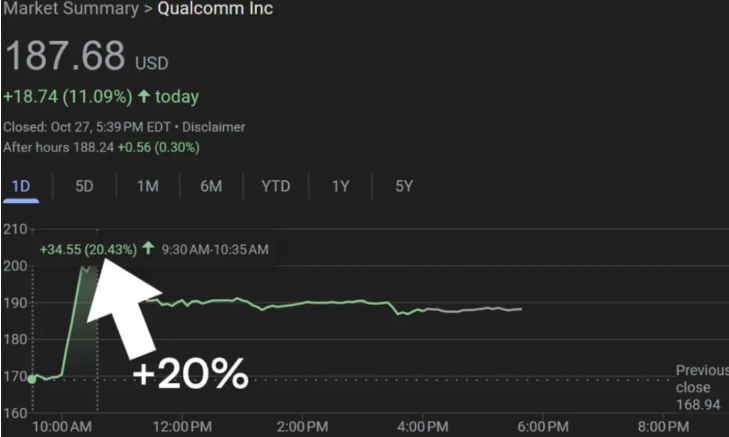

Recentemente, esse gigante conhecido por chips para celulares anunciou o lançamento de dois novos chips especialmente desenvolvidos para raciocínio de inteligência artificial em nuvem: o AI200 (comercializado em 2026) e o AI250 (lançado em 2027), marcando uma transição crucial da empresa de fornecedora de chips para dispositivos finais para um jogador completo na infraestrutura de IA. Com a notícia, as ações da Qualcomm subiram mais de 20% em um único dia, registrando o maior aumento desde 2019, com o mercado capitalista votando confiança com dinheiro real.

Focando em cenários de raciocínio, superando desafios com eficiência energética e custo

Diferente da abordagem completa de treinamento + raciocínio da NVIDIA, a Qualcomm escolheu focar no mercado de raciocínio de grandes modelos, destacando três vantagens principais: "baixo custo total de propriedade (TCO) + alta eficiência energética + grande memória".

- O AI200 suporta até 768 GB de memória LPDDR, podendo ser entregue como placa de aceleração independente ou sistema completo, otimizado para modelos de linguagem grande e raciocínio multimodal, atendendo às necessidades das empresas de alto paralelismo e baixa latência;

- O AI250 vai ainda mais longe, introduzindo uma arquitetura de cálculo próximo à memória (near-memory computing), afirmando que aumenta a largura de banda da memória em 10 vezes, ao mesmo tempo reduzindo significativamente o consumo de energia, estabelecendo um novo padrão de eficiência energética para implantações ultramassivas.

Essa estratégia atinge diretamente os problemas dos centros de dados atuais: à medida que os custos de raciocínio de modelo crescem rapidamente, as empresas precisam urgentemente de soluções especializadas de alto custo-benefício e baixo consumo de energia, em vez de buscar apenas potência de cálculo máxima.

Dez anos de preparação, o Hexagon NPU se torna o motor-chave

A Qualcomm não agiu por impulso. Desde 2019, a empresa já havia acumulado experiência em chips para nuvem nos campos de Internet das Coisas e computação de borda 5G, enquanto sua arma principal era seu próprio processador neural Hexagon (NPU). Após anos de iterações, o Hexagon evoluiu de acelerador de IA para dispositivos móveis para um motor de raciocínio de alto desempenho escalável para centros de dados, tornando-se o ponto técnico para a Qualcomm desafiar o mercado de nuvem.

Empresas gigantes competindo contra a NVIDIA, o mercado enfrenta um ponto de virada de "descentralização"

Apesar de a NVIDIA ainda dominar cerca de 90% do mercado de chips de IA, a demanda dos clientes por diversificação da cadeia de suprimentos está crescendo fortemente. Fornecedores de nuvem como Google (TPU), Amazon (Trainium/Inferentia), Microsoft (Maia) já desenvolveram seus próprios chips, e a entrada da Qualcomm oferece uma nova opção para fornecedores independentes terceirizados. A McKinsey prevê que até 2030, os investimentos globais em centros de dados atingirão 6,7 trilhões de dólares, um mercado azul suficientemente amplo para abrigar vários jogadores.

A Qualcomm já conquistou seu primeiro cliente importante: a startup de IA saudita Humain planeja implantar sistemas de gaveta baseados nos chips AI200/AI250 em 2026, com potência total de 200 megawatts, equivalente ao consumo de energia de uma pequena cidade.

Poderá desafiar o líder? A chave está na ecologia e na implementação

Desafiar a NVIDIA, a performance dos chips é apenas um ingresso, mas a ecologia de software, o suporte aos desenvolvedores e os resultados reais da implementação são decisivos. A Qualcomm conseguirá replicar sua capacidade de integração de ecologia no setor móvel, construindo uma pilha completa de raciocínio desde ferramentas até estruturas, determinará se ela realmente poderá dividir o mercado de alto nível.

Mas de qualquer forma, a entrada forte da Qualcomm já trouxe uma variável pesada para o campo de chips de IA. Quando o "rei dos chips de celular" decide causar uma tempestade na nuvem, o fosso de proteção da NVIDIA talvez não seja mais tão sólido quanto antes.